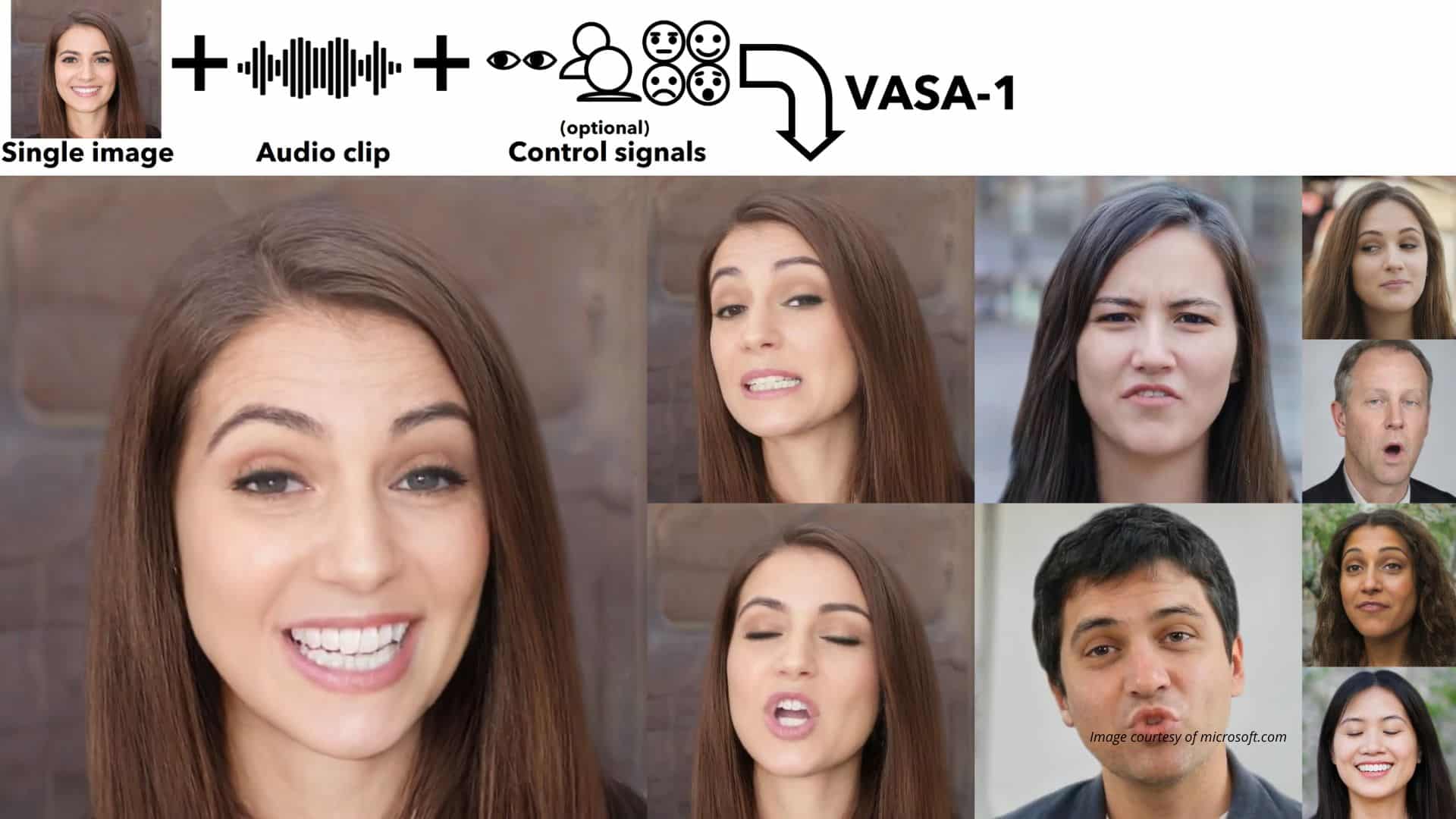

Una foto, un campione della propria voce e poi un click. E in pochi minuti la nuova AI di Microsoft crea una testa parlante animata dal vivo con il proprio volto. Questo è quanto promette VASA-1, l’ultima intelligenza artificiale di casa Redmond.

Presentata in un recente articolo di ricerca del colosso tech, questa AI potrebbe risultare alquanto innovativa per la facilità e la velocità con cui riesce ad animare un volto, con tanto di movimenti e voce.

E alquanto disturbante per l’incredibile realismo delle sue elaborazioni, soprattutto in un periodo in cui i deepfake stanno diventando problematici anche per le aziende, oltre che per le istituzioni.

Come funziona VASA-1, la nuova AI di Microsoft

Presentata in anteprima nel suo articolo di ricerca, al momento VASA-1 non è disponibile per il pubblico, ma solo per il team di ricerca di Microsoft. Il suo funzionamento ancora non è stato reso noto da Microsoft, anche perché per gli esperimenti sono stati utilizzati degli avatar creati con l’intelligenza artificiale. Ma se può animare un’immagine IA realistica, può animare una foto reale, no?

Anche perché i video dimostrativi sembrano impressionanti, e questo nonostante tecnologie simili di sincronizzazione labiale e movimento della testa siano già disponibili con Runway e NVIDIA. Ma ciò che rende sbalorditiva VASA-1 è in realtà la qualità e il realismo dei suoi elaborati, davvero notevoli se paragonati a quelli della concorrenza.

Sempre nell’articolo il team afferma che al momento si tratta solo di una demo a fini di ricerca, e senza piani per un rilascio pubblico o per renderlo disponibile agli sviluppatori di prodotti videoludici o grafici.

Cosa serve per fare un deepfake

Particolarità di VASA-1 è il fatto che (sembra) non richieda alcun’immagine di tipo ritratto frontale per funzionare. A giudicare dagli esempi, sono stati utilizzati anche scatti che guardano in qualsiasi direzione. Pertanto il modello AI sembra in grado di comprendere:

- la direzione dello sguardo,

- la distanza della testa,

- l’emozione espressa.

Una cosa che ha sorpreso i ricercatori è stata anche la capacità di VASA-1 di sincronizzare perfettamente la labbra su una canzone, ripetendo le parole del cantante senza problemi. E questo nonostante non sia stata utilizzata alcuna musica nel dataset di allenamento. Basti vedere i risultati con Monna Lisa, presentata in deepfake mentre fa rap.

A livello tecnico, i ricercatori sottolineano che per la creazione di questi deepfake sia necessaria una GPU Nvidia RTX 4090 per desktop (o similari a livello di benchmark). Alla fine l’elaborato di VASA-1 si compone una serie di immagini con risoluzione 512×512 pixel a 45 frame al secondo. Un elaborato però fatto in meno di 2 minuti, e alla perfezione.