Con l’arrivo di iOS 26, iPadOS 26 e macOS 26, Apple offre agli sviluppatori un potente strumento per integrare l’intelligenza artificiale direttamente nelle app, senza compromettere la privacy degli utenti. Ossia il framework Foundation Models, che permette di eseguire modelli linguistici avanzati on-device, aprendo nuove possibilità per salute, didattica, creatività e produttività.

Con Foundation Models nuove esperienze di app basate su Apple Intelligence

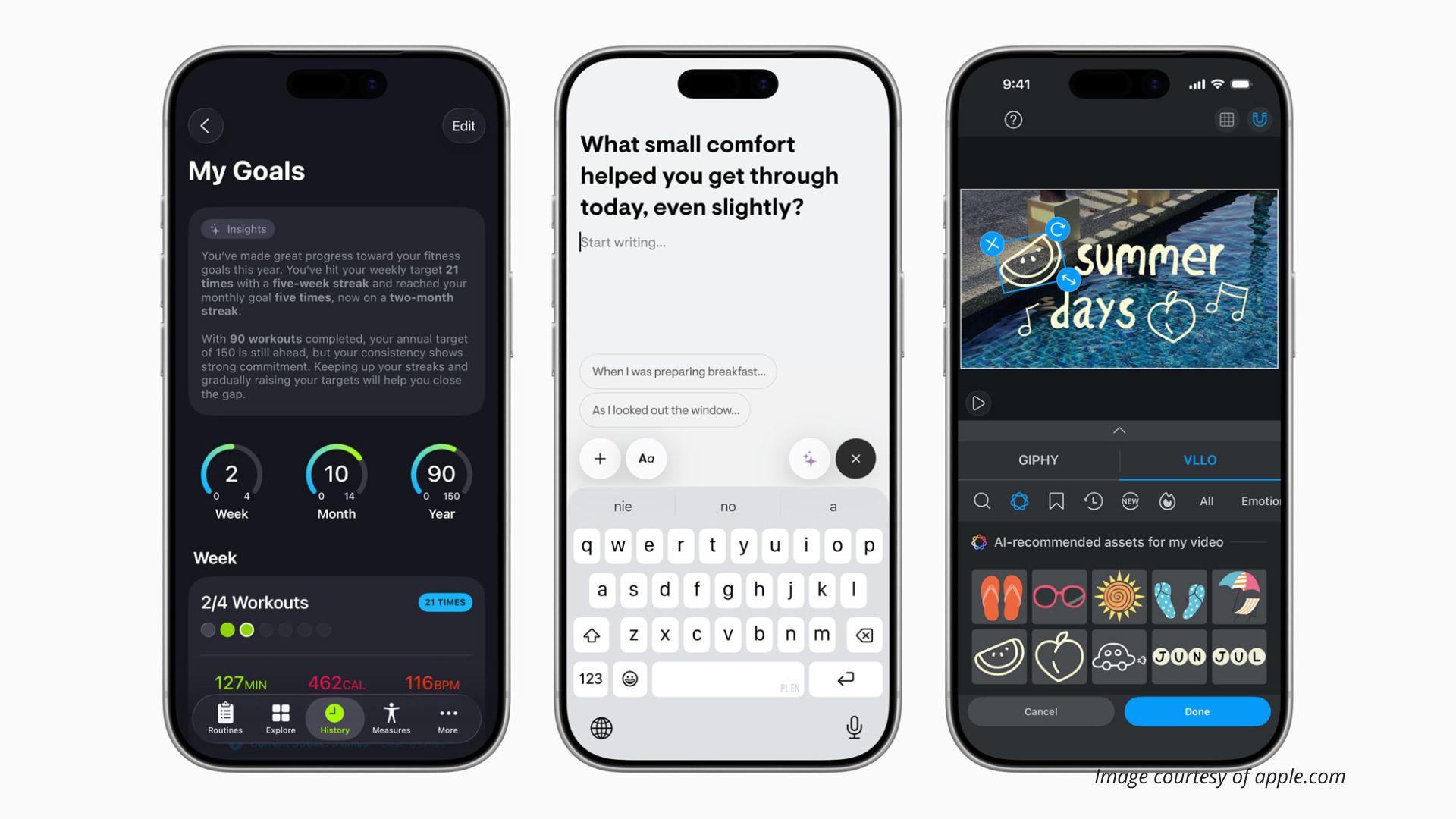

Dalla salute e fitness, all’istruzione e alla produttività: sono diverse le app che stanno già sfruttando il framework Foundation Models. Ecco solo alcune app che hanno sfruttato il framework per rilasciare nuove funzionalità di intelligence già disponibili.

Salute e benessere personale sempre più personalizzati

Tra le prime applicazioni a sfruttare Foundation Models c’è SmartGym, che trasforma semplici descrizioni di workout in routine complete, adattando serie, ripetizioni e tempi di recupero in base agli attrezzi disponibili. La funzione Smart Trainer suggerisce variazioni dei pesi e delle routine, spiegando il ragionamento dietro ogni proposta, e genera riepiloghi dettagliati dei progressi mensili.

Anche Stoic, app di journaling, utilizza il framework per fornire suggerimenti di scrittura basati sulle emozioni annotate dall’utente, creando messaggi empatici e riassunti delle voci del diario. App come SwingVision, 7 Minute Workout, Gratitude, Train Fitness, Motivation, Streaks e Wakeout! hanno adottato il framework per offrire feedback contestuali e attività adattive, arricchendo le esperienze di fitness e benessere direttamente on-device.

Didattica e apprendimento su misura

Sul fronte educativo, CellWalk sfrutta Foundation Models per generare spiegazioni colloquiali dei termini scientifici, calibrate sul livello dello studente. Il testo prende vita e diventa interattivo, potenziando l’apprendimento.

Altri esempi includono Grammo, che propone nuove domande di grammatica inglese, Lil Artist, che crea storie illustrate per bambini, Vocabulary, che organizza parole tematicamente, e Platzi, piattaforma per ispanofoni che risponde a domande contestuali sui contenuti video. In tutti i casi, le app offrono un’esperienza educativa più immediata, senza necessità di pesanti infrastrutture back-end.

Creatività e produttività completamente integrate

Il framework estende le possibilità anche in ambito creativo e produttivo. Stuff introduce Listen Mode e Scan Mode per dettare promemoria vocali o acquisire note scritte a mano. VLLO, app di editing video, combina Foundation Models e Vision per analizzare scene e suggerire musica e adesivi dinamici.

Altre app come Signeasy, Agenda, Detail: AI Video Editor, Essayist e OmniFocus 4 integrano funzioni on-device per generare riassunti, riferimenti bibliografici e progetti, semplificando attività complesse e migliorando l’interazione con l’utente.

Uno strumento versatile per gli sviluppatori

Foundation Models è pienamente integrato con Swift e offre un modello on-device da 3 miliardi di parametri. Gli sviluppatori possono inviare richieste direttamente dal codice esistente e utilizzare la generazione guidata per output coerenti. Quando necessario, il modello richiama strumenti interni alle app per risposte pertinenti e contestualizzate.

Disponibile su tutti i dispositivi compatibili con Apple Intelligence, il framework segna un passo importante nell’apertura dell’ecosistema Apple verso esperienze di AI sicure, private e integrate, già pronte per essere sfruttate in ambiti che spaziano dalla salute all’istruzione fino alla produttività personale.