La crescente diffusione di attacchi informatici basati sulle prompt injection, che mirano a far eseguire istruzioni malevole ai sistemi di intelligenza artificiale o a sottrarre dati sensibili, ha spinto OpenAI a introdurre nuove contromisure in ChatGPT. Tra queste spiccano la Lockdown Mode, una modalità di protezione avanzata, e un sistema di etichette di rischio elevato che segnalano funzionalità potenzialmente pericolose, per garantire maggiore sicurezza in scenari complessi di utilizzo dell’AI.

Lockdown Mode: sicurezza per utenti sensibili

La Lockdown Mode è pensata per utenti che operano in contesti particolarmente critici, come dirigenti o team di sicurezza di grandi organizzazioni. Non si tratta di una funzione destinata all’uso quotidiano, ma di un livello aggiuntivo per chi è esposto a minacce avanzate. Attivando questa modalità, ChatGPT limita drasticamente le interazioni con sistemi esterni, riducendo il rischio che dati riservati vengano sottratti attraverso istruzioni malevole nascoste nelle conversazioni.

In pratica, alcune funzionalità vengono disabilitate o fortemente ridotte. La navigazione web, ad esempio, può avvenire solo tramite contenuti memorizzati in cache, senza alcuna richiesta in tempo reale verso l’esterno. Dove non è possibile garantire un controllo deterministico sulla sicurezza, le funzioni vengono semplicemente escluse. L’obiettivo è evitare che informazioni sensibili possano uscire dall’infrastruttura controllata da OpenAI sfruttando strumenti apparentemente legittimi.

La Lockdown Mode si integra con le protezioni già disponibili nei piani business di ChatGPT, come i controlli sugli accessi, i log di audit e i sistemi di monitoraggio. È disponibile per i piani Enterprise, Edu, Healthcare e Teachers, e può essere attivata dagli amministratori tramite le impostazioni del workspace, creando ruoli dedicati.

Etichette “Elevated Risk”: più trasparenza sui pericoli

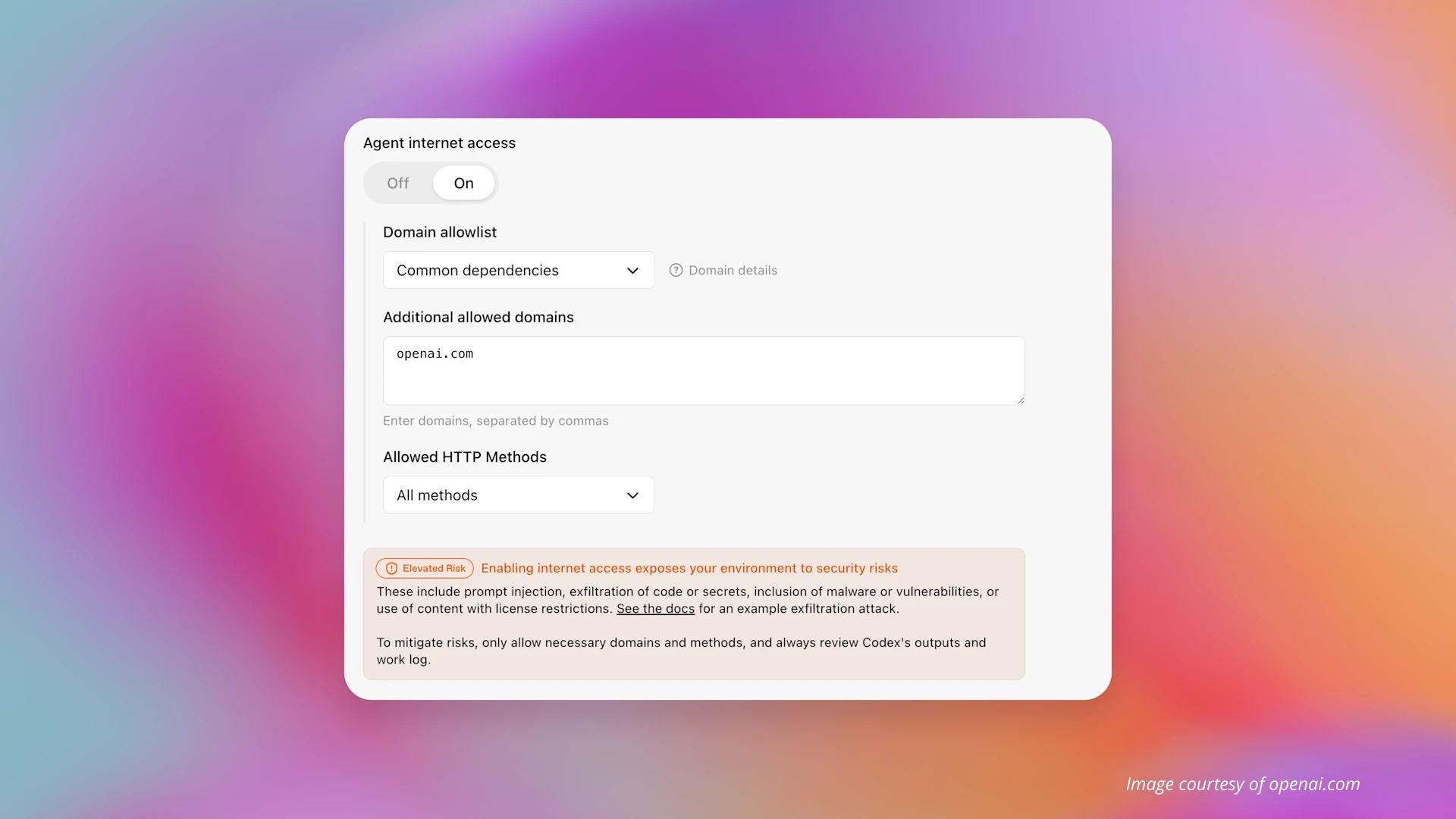

Accanto alle limitazioni tecniche, OpenAI ha introdotto un sistema di etichette “Elevated Risk” per aumentare la trasparenza sulle funzionalità più rischiose. Queste etichette compariranno in ChatGPT, ChatGPT Atlas e Codex, indicando subito quando un’azione comporta un’esposizione maggiore a minacce informatiche.

Un esempio è l’accesso a internet in Codex, l’assistente per la programmazione: quando agli sviluppatori viene permesso di far compiere al sistema azioni online, l’interfaccia segnala chiaramente il rischio, spiegando le implicazioni di sicurezza e in quali casi l’uso della funzione è giustificato.

OpenAI sottolinea che queste etichette non sono definitive. Con l’evolversi delle misure di sicurezza e la mitigazione dei rischi, l’indicazione “Elevated Risk” potrà essere rimossa o aggiornata, così da riflettere lo stato reale delle minacce e aiutare gli utenti a prendere decisioni più consapevoli quando lavorano con dati sensibili.

Verso un’AI più sicura e controllata

L’introduzione di Lockdown Mode e delle etichette di rischio rappresenta un passo importante per rendere ChatGPT più sicuro, soprattutto in scenari di utilizzo complessi e critici. Limitando l’accesso a funzioni potenzialmente pericolose e segnalando chiaramente i rischi, OpenAI punta a ridurre la superficie di attacco dei sistemi di intelligenza artificiale, proteggendo informazioni sensibili e aumentando la fiducia degli utenti in contesti professionali e strategici.