La vecchia generazione Nvidia torna protagonista nel mondo dell’intelligenza artificiale grazie a un progetto di modding che ha trasformato una GPU da server in una soluzione sorprendentemente competitiva per l’AI desktop. Lo YouTuber Hardware Haven ha infatti adattato una Nvidia Tesla V100 SMX, acquistata usata per appena 100 dollari, a un sistema consumer tramite un adattatore PCIe custom dal costo simile. Il risultato è una piattaforma da circa 200 dollari capace di ottenere prestazioni notevoli nell’inferenza AI e nell’esecuzione di modelli linguistici locali.

L’esperimento conferma una tendenza sempre più evidente: l’hardware enterprise di qualche anno fa può ancora dire la sua, soprattutto in un contesto in cui le GPU moderne dedicate all’intelligenza artificiale hanno prezzi sempre più elevati.

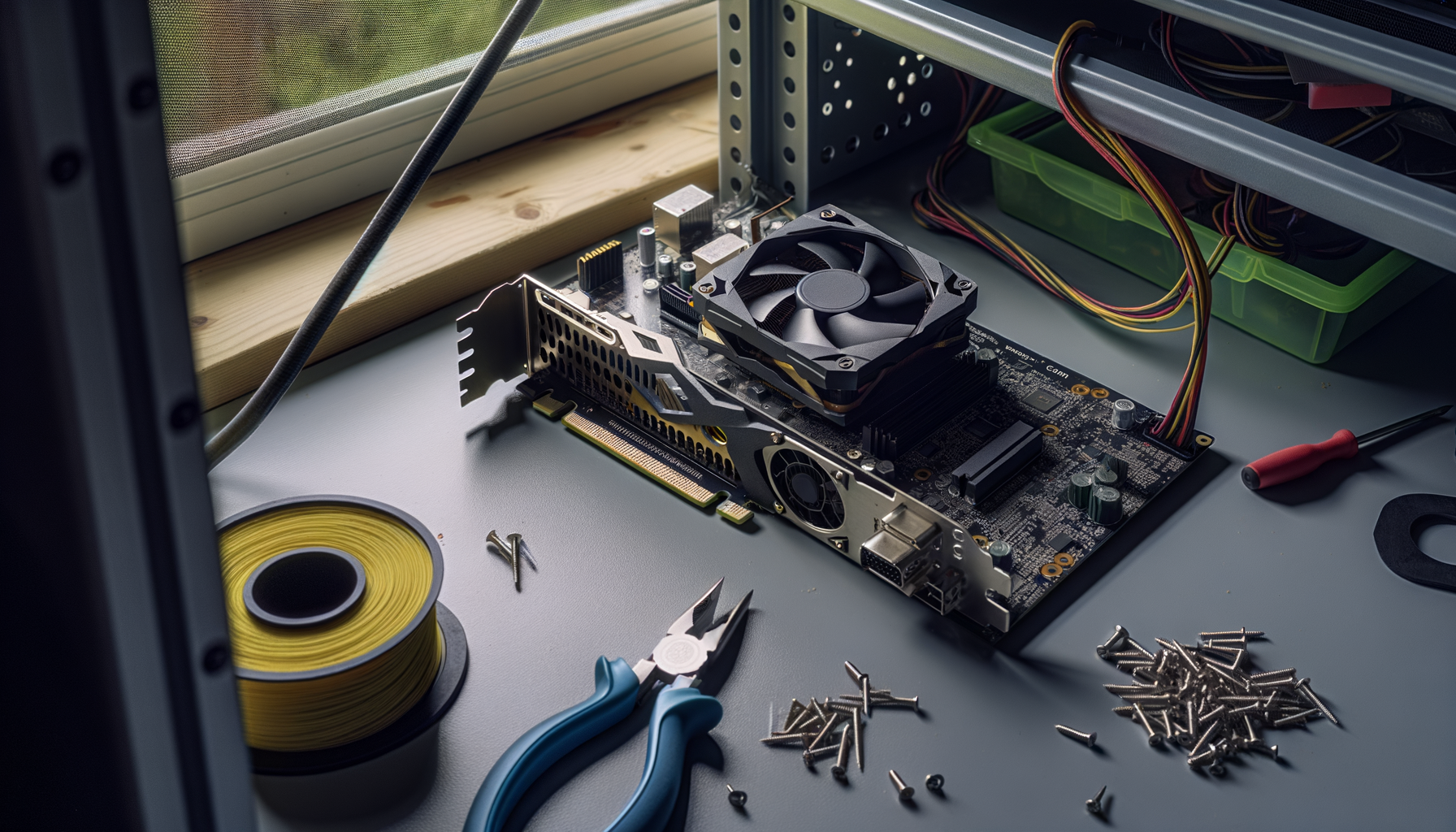

Conversione della Tesla V100: come una GPU da server è arrivata sui desktop

La protagonista del progetto è una Nvidia Tesla V100 SMX2, acceleratore nato per i data center e progettato per installazioni rack professionali. A differenza delle normali schede video consumer, il modello utilizza un’interfaccia SMX, un sistema simile a un socket che permette di fissare la GPU direttamente a una scheda madre dedicata.

Per renderla compatibile con un comune PC desktop è stato necessario utilizzare un adattatore SMX-to-PCIe x16 dal valore di circa 100 dollari. La GPU, quindi, è stata installata all’interno di un sistema Ryzen standard, anche se con una limitazione importante: la V100 non possiede uscite video, rendendo necessaria la presenza di una grafica integrata o di una seconda GPU per utilizzare il computer.

Uno degli aspetti più interessanti riguarda il raffreddamento. La Tesla V100, infatti, non nasce per lavorare in un case tradizionale e dispone soltanto di un dissipatore passivo. Per questo motivo il creator ha progettato e stampato in 3D un condotto personalizzato, abbinandolo a una ventola Noctua da 80 mm per convogliare l’aria fresca direttamente sul dissipatore.

L’adattatore PCIe include inoltre due connettori di alimentazione PCIe a 8 pin e tre header PWM per la gestione delle ventole. Manca invece un secondo socket SMX dedicato a NVLink, una scelta probabilmente legata ai costi molto più elevati di queste soluzioni.

Prestazioni AI sorprendenti contro GPU moderne

La parte più interessante del progetto riguarda però le prestazioni. Nonostante si tratti di una GPU del 2017 con architettura Volta e 16 GB di memoria HBM2, la Tesla V100 ha dimostrato di poter competere con schede video molto più recenti nei carichi AI.

Nei test effettuati con Ollama e il modello gpt-oss-20b, la V100 ha raggiunto circa 130 token al secondo, superando una Radeon RX 7800 XT che si è fermata a circa 90 token al secondo. Un risultato significativo, considerando che entrambe dispongono di 16 GB di VRAM.

Il confronto più interessante è arrivato contro una RTX 3060 da 12 GB. Utilizzando il modello Google gemma4:e4b, la Tesla V100 ha toccato quota 108 token al secondo, mentre la RTX 3060 si è fermata a 76 token al secondo. Sul fronte energetico, però, la scheda Nvidia enterprise consumava di più: 293 W contro 235 W.

Riducendo il power limit della V100 da 300 W a 100 W, i consumi sono scesi a circa 170 W mantenendo comunque 95 token al secondo. Nello stesso scenario, anche limitando la RTX 3060 a 100 W, la scheda Ampere si è fermata a 68 token al secondo. In termini di efficienza, la V100 ha raggiunto circa 0,55 token per watt, contro gli 0,39 della RTX 3060.

Hardware legacy, stampa 3D e community maker

Il progetto mette in evidenza anche il ruolo crescente della community maker nel recupero di hardware professionale dismesso. Grazie a PCB custom, stampa 3D e componenti reperibili online, vecchie GPU enterprise possono trovare nuova vita in workstation dedicate all’intelligenza artificiale.

La Tesla V100 si è dimostrata efficace anche con Frigate NVR, software utilizzato per la videosorveglianza AI. Rispetto a un mini PC Intel N100, che faticava persino a riconoscere un cane tramite mobilenetv2, la GPU Nvidia riusciva a effettuare il riconoscimento quasi istantaneamente. I consumi, però, restano elevati: oltre 100 W monitorando soltanto due telecamere.

L’esperimento realizzato da Hardware Haven potrebbe inoltre avere un impatto immediato sul mercato dell’usato. Dopo la pubblicazione del video e la diffusione della notizia, il rischio concreto è che queste GPU diventino rapidamente più costose e difficili da reperire. Attualmente la versione da 16 GB può ancora essere trovata attorno ai 100 dollari, mentre la variante da 32 GB arriva già vicino ai 500 dollari.

Guida pratica: come sfruttare le soluzioni hardware AI modificate

Chi lavora in AI o desidera potenziare una workstation può prendere spunto da questa strategia con la GPU Nvidia Tesla V100 SMX. Il modding, se supportato da competenze, offre risparmi notevoli e flessibilità per progetti avanzati.

Investire in hardware legacy con aggiornamenti mirati rappresenta una via per massimizzare l’efficacia senza inseguire la novità a tutti i costi. Valuta sempre compatibilità, raffreddamento e supporto software prima di procedere.

Fonte: Tom’s Hardware