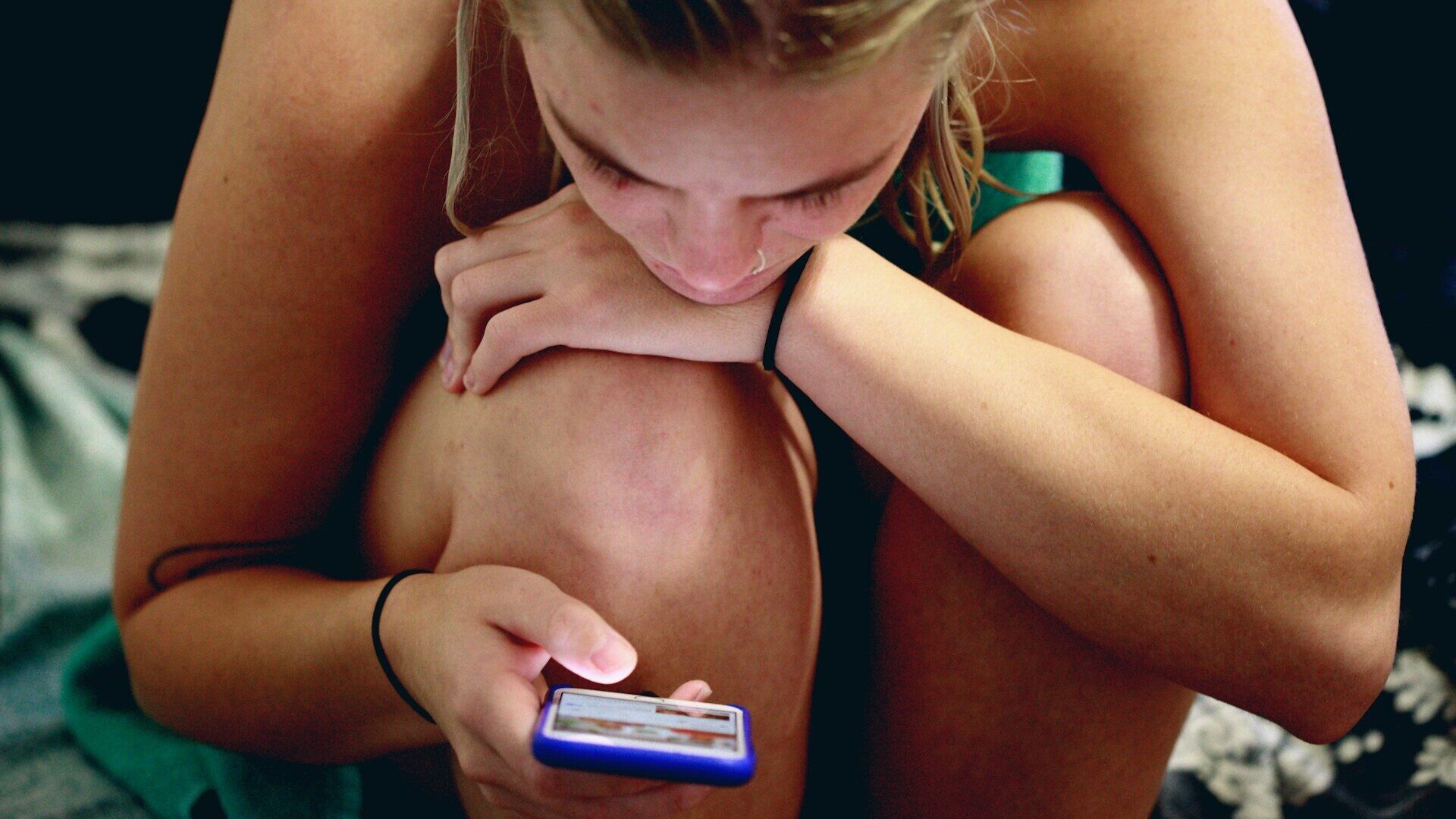

Dopo Australia e Stati Uniti, anche la Cina si muove per regolamentare l’uso dell’intelligenza artificiale tra i più giovani.

Limiti ai contenuti e responsabilità dei fornitori

Una bozza di regolamento della Cyberspace Administration cinese, riportata dalla CNBC, punta a impedire che i chatbot influenzino le emozioni umane in modi pericolosi, prevenendo il rischio di suicidio o autolesionismo tra gli utenti minorenni.

Secondo la bozza, i chatbot non devono generare contenuti con forte impatto emotivo, in particolare per i giovani, né ricorrere a violenza verbale o manipolazione psicologica. In caso di espressioni legate al suicidio, i fornitori tecnologici devono assicurarsi che una persona responsabile dell’AI “prenda il controllo della conversazione e contatti immediatamente il tutore dell’utente o una persona designata“, riporta la testata statunitense.

Inoltre, i servizi di intelligenza artificiale non devono produrre contenuti legati a gioco d’azzardo, scene oscene o violente. Le piattaforme sono invitate a sviluppare sistemi in grado di identificare gli utenti minorenni, anche quando questi non dichiarano la propria età, e applicare automaticamente impostazioni di protezione dedicate. Infine, i minorenni devono ottenere il consenso dei tutori per utilizzare l’AI a scopo di compagnia emotiva, e il tempo di utilizzo sarà limitato per ridurre rischi di esposizione e dipendenza.

La mossa della Cina si inserisce dunque in un contesto globale di crescente attenzione alla sicurezza dei minori online, e segna un passo avanti nel definire standard di tutela emotiva e comportamentale per l’interazione con intelligenze artificiali sempre più avanzate. C’è da dire che alcune aziende già hanno adottato misure simili: OpenAI ha aggiornato le proprie linee guida per rilevare indicatori della presenza di utenti minorenni, mentre Anthropic ha introdotto sistemi che bloccano completamente le conversazioni con under 18.