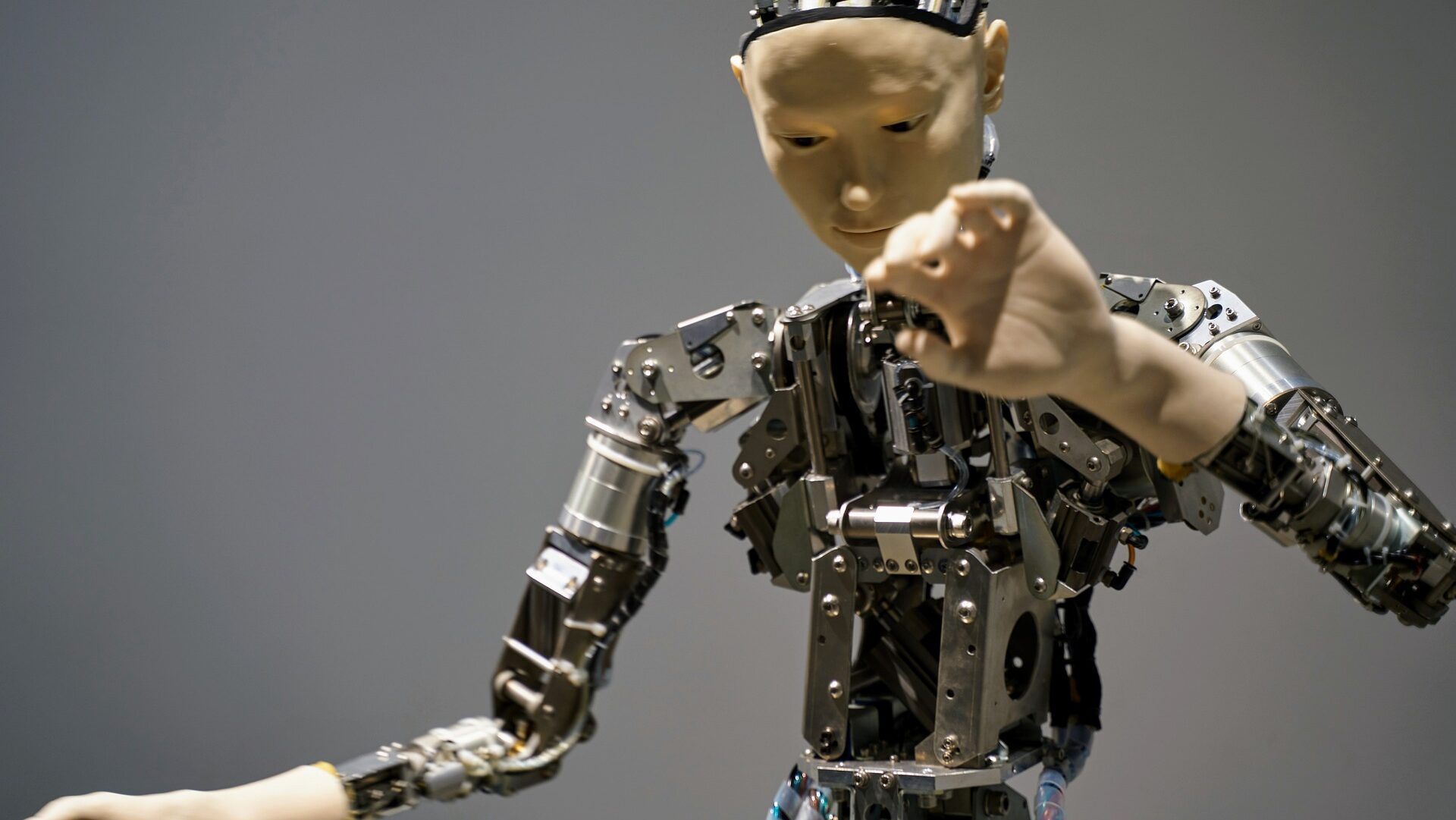

Un gruppo di ricercatori della Brown University ha presentato un’innovazione destinata a ridefinire l’interazione uomo-macchina: si chiama MotionGlot ed è un modello di intelligenza artificiale capace di tradurre comandi testuali in movimenti fisici, adattabili a robot dalle forme più diverse. Che si tratti di un automa a quattro zampe o di un robot umanoide, entrambi possono ricevere l’ordine “cammina avanti e poi gira a sinistra” ed eseguirlo in modo coerente rispetto alla loro struttura corporea. Un avanzamento che non riguarda solo l’automazione industriale, ma che promette applicazioni rivoluzionarie anche nell’animazione digitale e nel mondo del gaming, dove basterà descrivere a parole un’azione per animarla realisticamente.

I robot capiscono il linguaggio naturale: nasce MotionGlot

Stando a quanto riportato nella ricerca pubblicata su arXiv, il cuore tecnico di MotionGlot si ispira al funzionamento dei grandi modelli linguistici come ChatGPT. L’idea è semplice quanto geniale: se le parole possono essere suddivise in “token” per comprenderne il significato, lo stesso principio può essere applicato al movimento.

Il modello suddivide ogni azione fisica in fasi discrete – ad esempio, alzare una gamba, spostare il peso, abbassare l’altra – e, prevedendo il “token” motorio successivo, riesce a generare sequenze continue e naturali. Il risultato è una rappresentazione fluida del movimento, non rigida o pre-programmata, ma adattabile e realistica, anche in robot di morfologia completamente diversa.

Per addestrare MotionGlot, i ricercatori hanno utilizzato un doppio dataset: QUAD-LOCO, che contiene movimenti di robot quadrupedi, e QUES-CAP, una raccolta di azioni umane corredate da descrizioni testuali dettagliate. Questo approccio misto ha permesso al sistema di imparare a generalizzare un concetto motorio – come correre, saltare o camminare – a corpi con scheletri e articolazioni completamente diversi.

Ma ciò che sorprende è la capacità semantica dell’AI: comandi come “cammina felice” o “fai esercizio cardio” non generano movimenti standard, ma azioni che rispecchiano l’intenzione emotiva o funzionale espressa dal testo. Uno sviluppo che potrebbe rivoluzionare anche la realtà virtuale, dove i personaggi reagirebbero in tempo reale alle descrizioni fornite dagli utenti.

Al momento, MotionGlot è stato testato esclusivamente in ambienti controllati e necessita di molti più dati per poter essere implementato su larga scala. Ma le premesse sono promettenti. Secondo Srinath Sridhar, uno dei ricercatori coinvolti nel progetto, l’obiettivo è estendere il dataset e rendere il codice open-source, così da coinvolgere sviluppatori di tutto il mondo nell’affinamento del modello.