L’intelligenza artificiale applicata all’analisi delle immagini sta ridefinendo confini e opportunità in numerosi settori strategici. Dalla sanità alla sicurezza, dall’industria al marketing digitale, le tecnologie di visione artificiale consentono ai sistemi informatici di interpretare contenuti visivi con livelli di precisione sempre più elevati. Un’evoluzione che non riguarda solo l’efficienza operativa, ma che incide profondamente anche sulle dinamiche sociali, normative ed etiche.

Sanità, sicurezza e commercio: dove l’IA cambia le regole

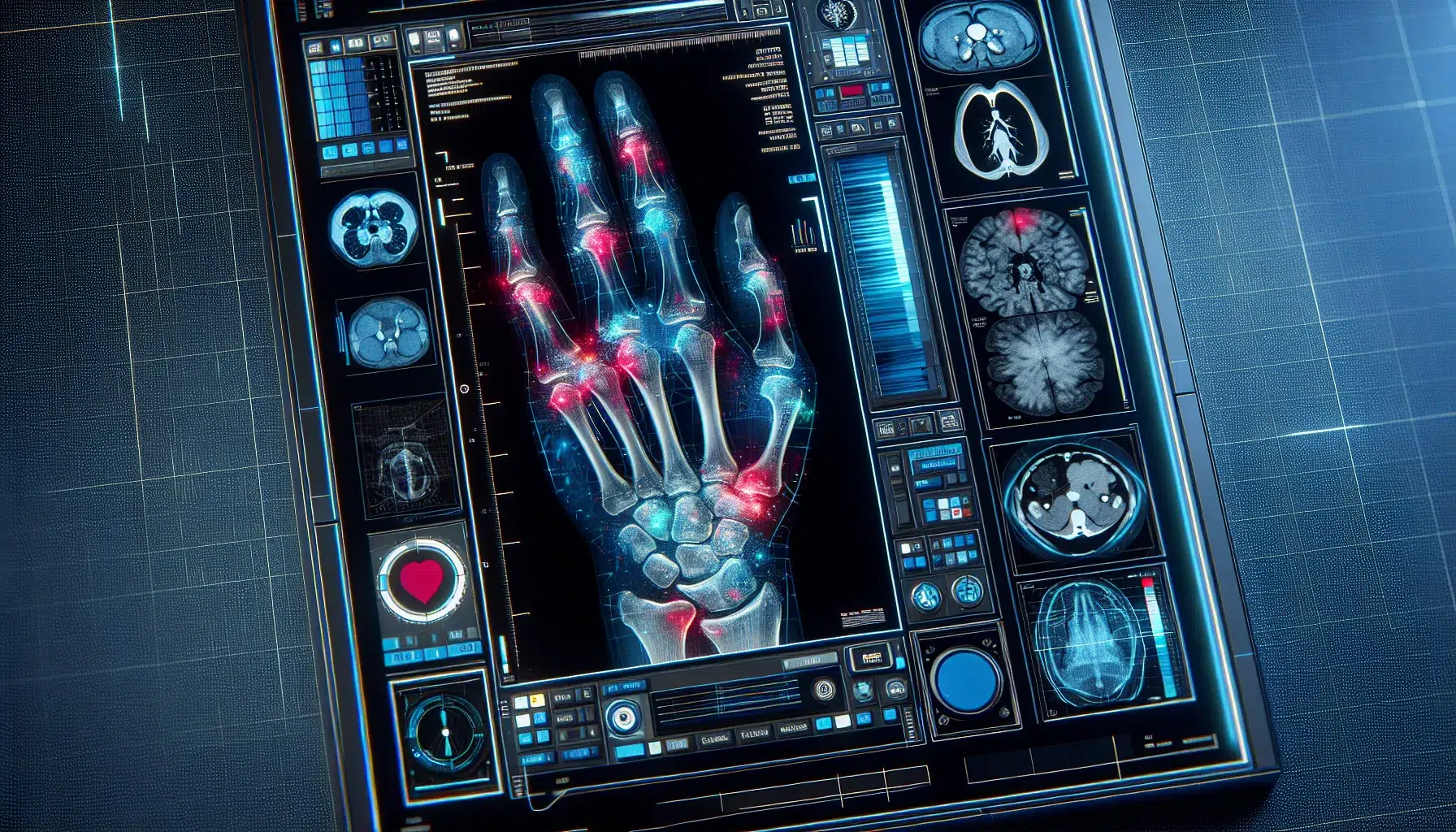

In ambito medico, l’analisi automatizzata di radiografie, tomografie e risonanze magnetiche tramite algoritmi di machine learning permette di individuare anomalie con maggiore rapidità. L’obiettivo è supportare il lavoro dei professionisti sanitari, rendendo le diagnosi più tempestive e accurate. L’intelligenza artificiale non sostituisce il medico, ma affianca la valutazione clinica attraverso modelli capaci di riconoscere pattern difficilmente individuabili a occhio nudo.

Parallelamente, nel settore della sicurezza, la sorveglianza intelligente rappresenta uno degli ambiti di maggiore espansione. Telecamere dotate di algoritmi avanzati sono in grado di rilevare comportamenti anomali o identificare individui sospetti, contribuendo alla prevenzione di attività criminali. I sistemi di riconoscimento facciale, sempre più diffusi nei luoghi pubblici e nei varchi di accesso, promettono maggiore controllo ma aprono interrogativi rilevanti sul piano dei diritti individuali.

Anche l’e-commerce beneficia in modo significativo dell’analisi delle immagini. Il visual search consente agli utenti di cercare prodotti caricando semplicemente una fotografia, trasformando l’esperienza d’acquisto in un processo più intuitivo. Allo stesso tempo, gli algoritmi analizzano le preferenze visive dei consumatori per proporre suggerimenti personalizzati, migliorando la qualità dell’interazione tra cliente e piattaforma.

Deep learning e reti neurali: il cuore del riconoscimento visivo

La vera svolta tecnologica è arrivata con il deep learning. Le reti neurali convoluzionali (CNN) sono progettate per elaborare enormi quantità di dati visivi ed estrarre automaticamente le caratteristiche più rilevanti dalle immagini. A differenza dei sistemi tradizionali, non richiedono una selezione manuale delle proprietà da analizzare: apprendono direttamente dai dati.

Il processo di addestramento avviene su volumi imponenti di immagini, consentendo agli algoritmi di riconoscere schemi e correlazioni estremamente complessi. In molti casi, l’accuratezza raggiunta nel riconoscimento di oggetti, persone ed emozioni supera quella umana. Questo progresso ha avuto ricadute concrete in diversi ambiti: dalla classificazione fine delle immagini al controllo qualità nella produzione industriale, dove i sistemi individuano difetti o anomalie in modo automatico.

Per migliorare la robustezza dei modelli, vengono impiegate tecniche di data augmentation, che generano varianti delle immagini originali attraverso rotazioni, zoom o modifiche cromatiche. Così facendo, si amplia la varietà dei dati di addestramento e si rende il sistema più efficace in contesti nuovi o imprevisti.

Nel panorama della visione artificiale si sono affermate anche le reti generative avversarie (GAN). Basate su una dinamica competitiva tra due reti – una che genera immagini e una che ne valuta l’autenticità – permettono di creare contenuti fotorealistici, volumetrie 3D e persino video sintetici. Innovazioni che ampliano il potenziale creativo e applicativo, ma che sollevano interrogativi sull’autenticità dei contenuti e sulla tutela del copyright.

Questioni etiche, responsabilità e regolamentazione

L’espansione dell’intelligenza artificiale nell’analisi delle immagini porta con sé sfide complesse. La privacy è uno dei nodi centrali. L’utilizzo diffuso del riconoscimento facciale e dei sistemi di monitoraggio in spazi pubblici impone una riflessione sui limiti di applicazione e sul consenso degli individui coinvolti.

Un ulteriore elemento critico riguarda il rischio di bias. La qualità dei dataset utilizzati per l’addestramento è determinante: dati non rappresentativi possono generare discriminazioni o perpetuare stereotipi. L’accuratezza delle decisioni algoritmiche è strettamente legata alla qualità e alla varietà delle immagini di partenza. Per questo motivo, aziende e istituzioni sono chiamate ad adottare pratiche trasparenti e responsabili.

Resta aperta anche la questione della responsabilità legale. Se un sistema identifica erroneamente un individuo come minaccia, chi ne risponde? La definizione di quadri normativi chiari è fondamentale per stabilire doveri e limiti di sviluppatori e utilizzatori. A ciò si aggiunge l’impatto ambientale dell’addestramento dei modelli, che richiede notevoli risorse energetiche.

Le prospettive future sono ampie, ma richiedono un equilibrio tra innovazione e tutela dei diritti. Sarà necessario investire nella formazione etica degli sviluppatori, nel coinvolgimento delle comunità e nella costruzione di politiche capaci di governare queste tecnologie. Solo attraverso un approccio consapevole sarà possibile garantire che i benefici dell’analisi delle immagini siano distribuiti equamente, senza compromettere principi fondamentali.